Regeln im Umgang mit ML/KI - Prinzipien der BaFin [Teil 4]: Spezifische Prinzipien der Anwendung

Was ist bei der Anwendung eines KI-, ML- und Big Data Prozesses zu beachten? Wir klären auf.

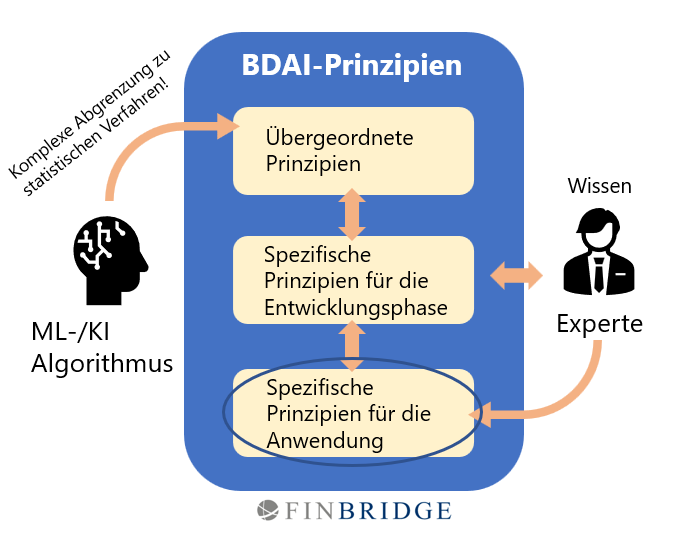

Im ersten Teil ging es um drei Prinzipien(-Abschnitte), welche die Bafin und Buba als Resultat mehrerer Studien, Anwendungen und Projekte abgeleitet hat um minimale Anforderungen und Erwartungen im Umgang mit der BDAI-Technologie (Big Data Artificial Intelligence) auf die Beine zu stellen. Hier soll es um die Prinzipien aus dem letzten Punkt gehen, die “spezifischen Prinzipien der Anwendung”.

5 Punkte sind hierbei während der Anwendung von AI- oder ML- zu beachten:

Interpretation und Verwertung algorithmischer Ergebnisse für die Entscheidungsfindung erfolgen automatisiert - für besondere Fragen werden Experten einbezogen,

„Putting the human in the loop“-Prinzip: Einbindung der Beschäftigten in die Interpretation und Verwertung - Definition eines Zeitfensters für die Revidierung von Entscheidungen durch menschliche Intervention,

Resilience Mechanismus: Kontrolle, Feedbackloops & Anpassungsregeln - Interaktionen mit anderen Algorithmen sowie Einklang mit Risikomanagement (Stichwort Risikoaggregation) beachten,

Intensive Freigabe- und Feedbackprozesse für algorithmisch erzeugte Ergebnisse/Entscheidungsprozesse: risikoorientierte Definition der Situationen eines intensiven Freigabeprozesses: etwa stufenweises Vorgehen mit Hilfe von Schwellenwerten (hierzu zählt die Etablierung von Notmaßnahmen bei Problemen von algorithmenbasierten Entscheidungsprozessen),

Laufende Validierung, übergeordnete Evaluation in der Praxis - besonders bei unvorgesehenen internen und ext. Risiken.

Ein Stufenmodell kann bspw. wie folgt aufgesetzt sein:

Stufe: Freigabe durch Mensch oder automatischer (deterministischer) Prozess,

Stufe: Zusätzliche Überprüfung der Inputdaten auf mögliche Besonderheiten (z.Bsp. Ausreißer),

Stufe: Freigabeentscheidungen für die Fortsetzung und des Stops der Prozessierung (”Stopping-Rule”) festlegen - anschließend folgt das Signal zur Überprüfung des Modells (Ad-hoc-Validierung mit möglicher Folge der Modellkalibrierung und der Auswahl neuer Parameter). Eine Freigabe ist erst nach intensiver Überprüfung bzw. Änderung der Ergebnisse möglich.

Die BaFin und die Deutsche Bundesbank haben über das Prinzipienpapier hinaus im Juli 2021 das Konsultationspapier „Maschinelles Lernen in Risikomodellen – Charakteristika und aufsichtliche Schwerpunkte“ veröffentlicht und um Rückmeldungen aus dem Versicherungs- und Bankenbereich gebeten. Inzwischen wurden die Antworten ausgewertet und in einem Ergebnispapier (11/2021) zusammengefasst. Um die Kerninhalte des Ergebnispapiers geht es hier.

Quelle: Prinzipienpapier “Big Data und künstliche Intelligenz: Prinzipien für den Einsatz von Algorithmen in Entscheidungsprozessen” der BaFin vom 15.06.2021